HappyHorse - Das neueste KI-Video-Modell von Alibaba

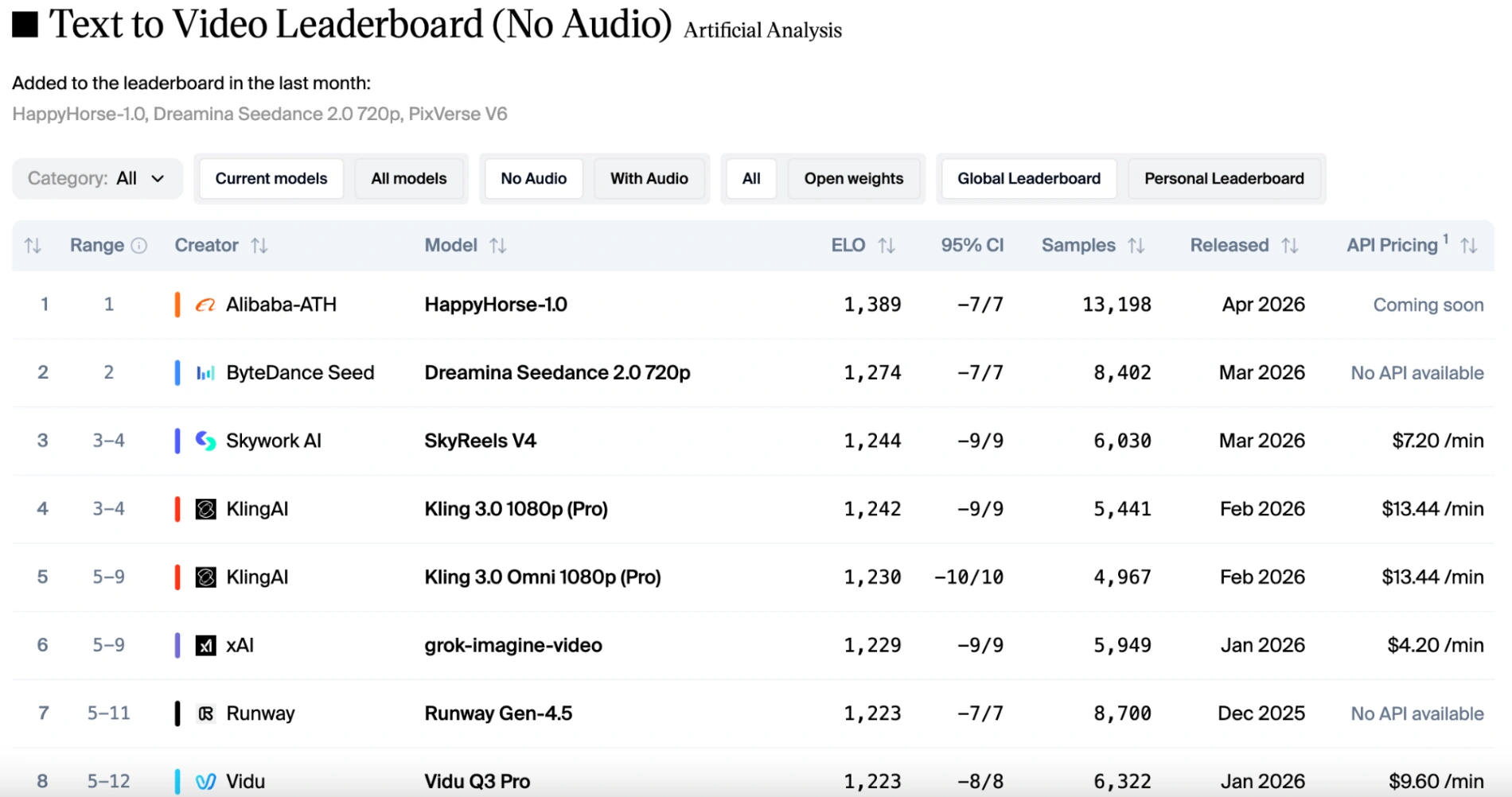

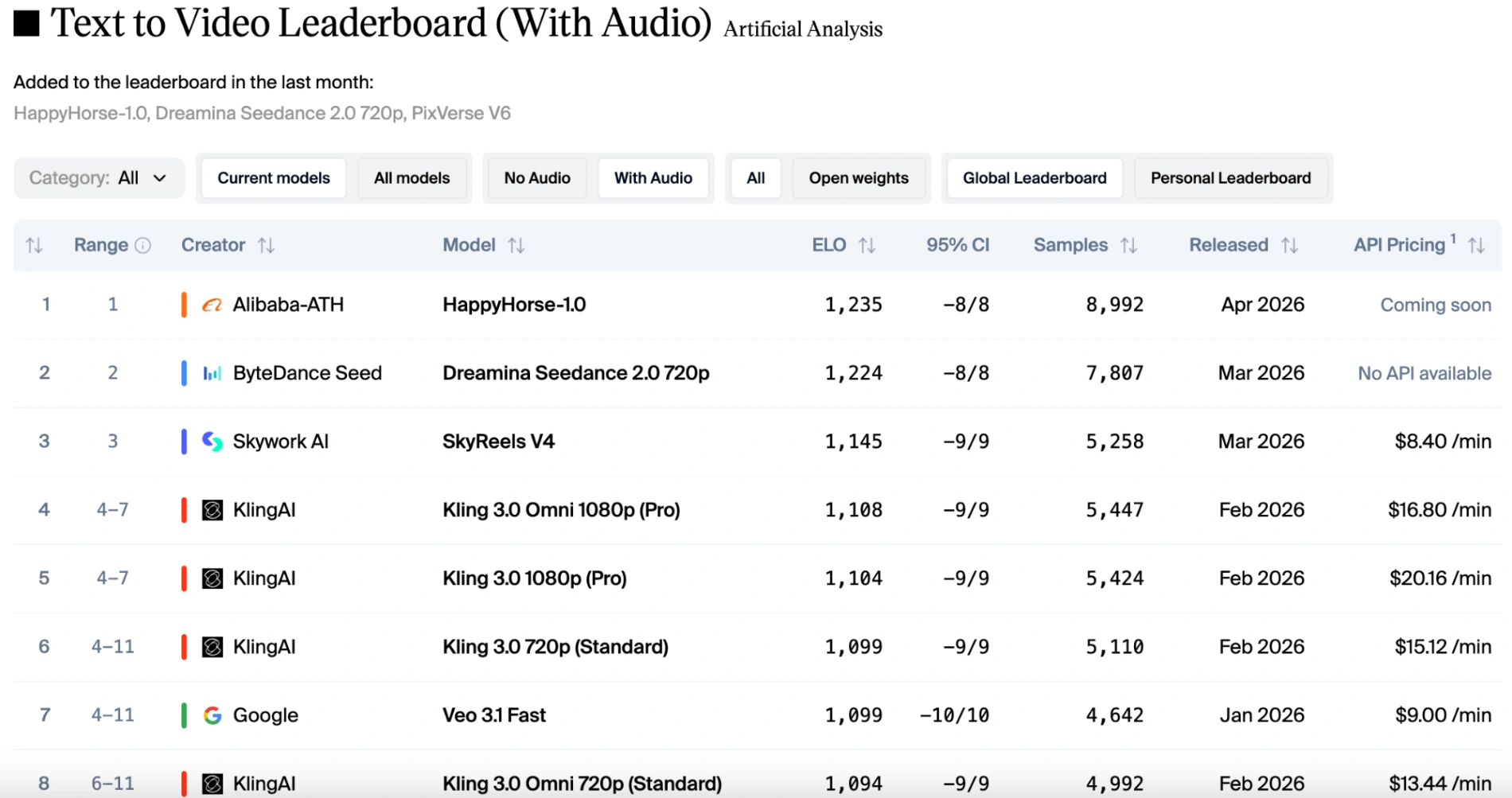

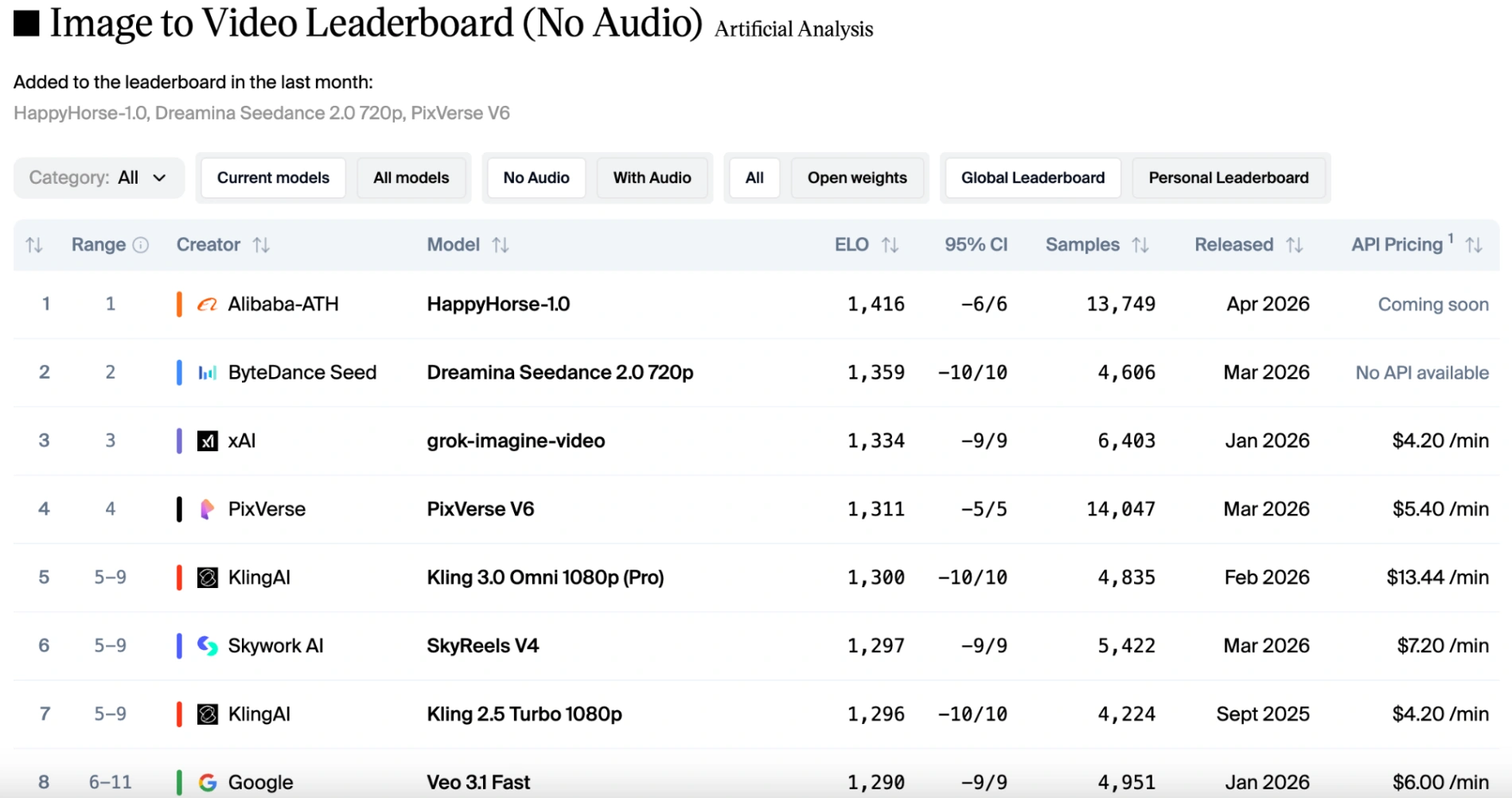

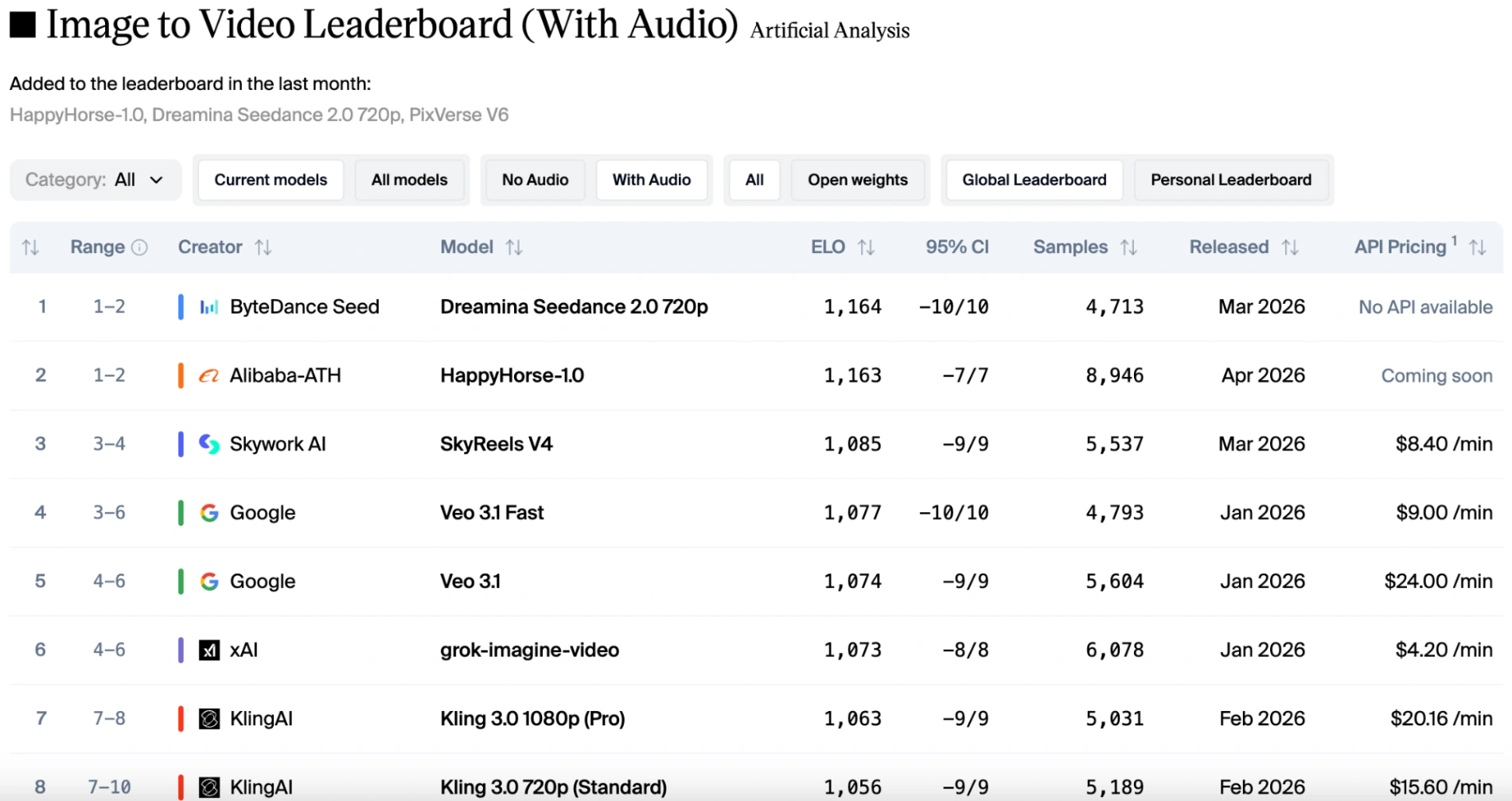

HappyHorse ist das neueste KI-Video-Modell von Alibabas ATH AI Innovation Unit. HappyHorse-1.0 belegt Platz #1 auf der Artificial Analysis Video Arena. Es unterstützt alle vier Video-Generierungsmodalitäten: Text-zu-Video und Bild-zu-Video, jeweils mit und ohne native Audio.

Vereinheitlichte Audio- und Video-Synthese

HappyHorse 1.0 vereinfacht den kreativen Prozess, indem es sowohl hochwertiges Video als auch synchronisierte Soundeffekte direkt aus einem einzigen Text-Prompt generiert. Durch die Verarbeitung von Video- und Audio-Tokens innerhalb einer vereinheitlichten Transformer-Sequenz stellt das Modell sicher, dass auditive Elemente natürlich mit den Aktionen auf dem Bildschirm übereinstimmen (wie eine plätschernde Welle oder Motorengeräusche), was dazu beiträgt, zusätzliche Audio-Nachbearbeitung zu reduzieren.

Konsistente Bild-zu-Video-Animation

Um statische Bilder zum Leben zu erwecken, zeigt dieses Modell eine starke Leistung auf der Artificial Analysis Video Arena, einschließlich eines bemerkenswerten Elo-Scores von 1416 in der Bild-zu-Video-Spur (ohne Audio). Es konzentriert sich darauf, die Charakterkonsistenz aufrechtzuerhalten und Umgebungsdetails zu bewahren, was es zu einer praktischen Option für die Animation von Konzeptkunst, Porträts und Produktfotos macht.

Physikbewusste Bewegungsmodellierung

Um häufige visuelle Probleme wie "unnatürliche", verzerrte Bewegungen in KI-Videos zu adressieren, nutzt HappyHorse einen optimierten Bewegungsmotor, der darauf ausgelegt ist, die Physik der realen Welt zu respektieren. Dies hilft, flüssige menschliche Gangarten, realistische Fluiddynamik und stabile Kamerafahrten zu erzeugen. Durch das Verständnis physikalischer Einschränkungen reduziert das Modell signifikant die Verzerrungsartefakte, die oft in früheren Generationen von Video-Tools zu sehen sind.

Native mehrsprachige Prompt-Verständnis

Als natives multimodales Modell verarbeitet HappyHorse direkt Prompts in mehreren Sprachen (einschließlich Englisch, Chinesisch und Japanisch) ohne auf Zwischenübersetzungsschritte angewiesen zu sein. Dies ermöglicht es Nutzern, kulturell spezifische Beschreibungen in ihrer Muttersprache einzugeben, was dazu beiträgt, die Genauigkeit und subtilen visuellen Nuancen des ursprünglichen Text-Prompts zu erhalten.

Effizienter 8-Schritt-Generierungsprozess

Technische Effizienz ist ein Schwerpunkt für HappyHorse 1.0, das klare Videoausgaben in nur 8 Entrauschungsschritten erreicht. Durch die Nutzung einer optimierten Transformer-Architektur und fortschrittlicher Abtasttechniken liefert das Modell eine 1,2-fache End-to-End-Beschleunigung. Dieser schnellere Generierungsprozess ermöglicht es Kreativen, Ideen zu testen und ihre Projekte komfortabler zu iterieren.

Genaue Lippensynchronisation und Dialogabstimmung

Das Modell integriert dedizierte Lippensynchronisations-Fähigkeiten, die darauf ausgelegt sind, gesprochene Dialoge mit Mundbewegungen von Charakteren abzustimmen. Durch das Ziel eines "ultra-niedrigen WER" (Word Error Rate) stellt HappyHorse sicher, dass generierte Sprache natürlich mit den visuellen Elementen übereinstimmt. Diese Funktion optimiert den Animations-Workflow, indem sie den Bedarf an manuellen Timing-Anpassungen in externer Software minimiert.

Social-Media-Inhaltserstellung

Kreative können effizient ansprechende Kurzvideos für Plattformen wie TikTok oder YouTube Shorts produzieren. Durch die Nutzung des schnellen Generierungsprozesses und der nativen Audio-Funktionen können Influencer hohe Veröffentlichungsfrequenzen aufrechterhalten und gleichzeitig die manuelle Audio-Bearbeitungszeit erheblich reduzieren.

Marketing und Markenwerbung

Werbe-Teams können hochwertige Markenwerbespots aus einfachen Textbeschreibungen oder Produktfotos erstellen. Die native mehrsprachige Prompt-Unterstützung ermöglicht nahtloses globales Marketing, sodass Teams leicht kulturell relevante lokalisierte Kampagnen generieren können.

Spielentwicklungs-Prototyping

Spieleentwickler können schnell filmische Zwischensequenzen und Umgebungsanimationen prototypisieren. Mit der vereinheitlichten Audio- und Video-Synthese können Studios synchronisierte räumliche Audio neben den visuellen Elementen generieren, was hilft, die finale Spielatmosphäre früh im Entwicklungszyklus zu visualisieren.

Digitale Kunst-Animation

Digitale Künstler können statische Illustrationen oder Konzeptkunst in immersive bewegte Werke verwandeln. Durch die Nutzung der starken Bild-zu-Video-Fähigkeiten des Modells können Kreative strenge Charakter- und Umgebungskonsistenz bewahren, ohne den ursprünglichen künstlerischen Stil zu verlieren.

Filmische narrative Erzählung

Unabhängige Filmemacher können die Pre-Production und Visualisierung von Kurzfilmen optimieren. Der physikbewusste Bewegungsmotor und die präzisen Lippensynchronisations-Fähigkeiten ermöglichen es Regisseuren, komplexe narrative Sequenzen mit realistischen menschlichen Bewegungen und synchronisierten Dialogen zu erstellen.

E-Commerce-Produktvisualisierung

Einzelhändler können ihre Online-Shopfronten aufwerten, indem sie statische Produktaufnahmen in dynamische Präsentationsvideos verwandeln. Das Modell gewährleistet physikalische Genauigkeit und fügt perfekt abgestimmte Soundeffekte hinzu (wie das Rascheln von Stoff oder mechanische Klicks), was ein fesselndes virtuelles Erlebnis für Online-Shopper bietet.