HappyHorse - O mais recente modelo de vídeo por IA da Alibaba

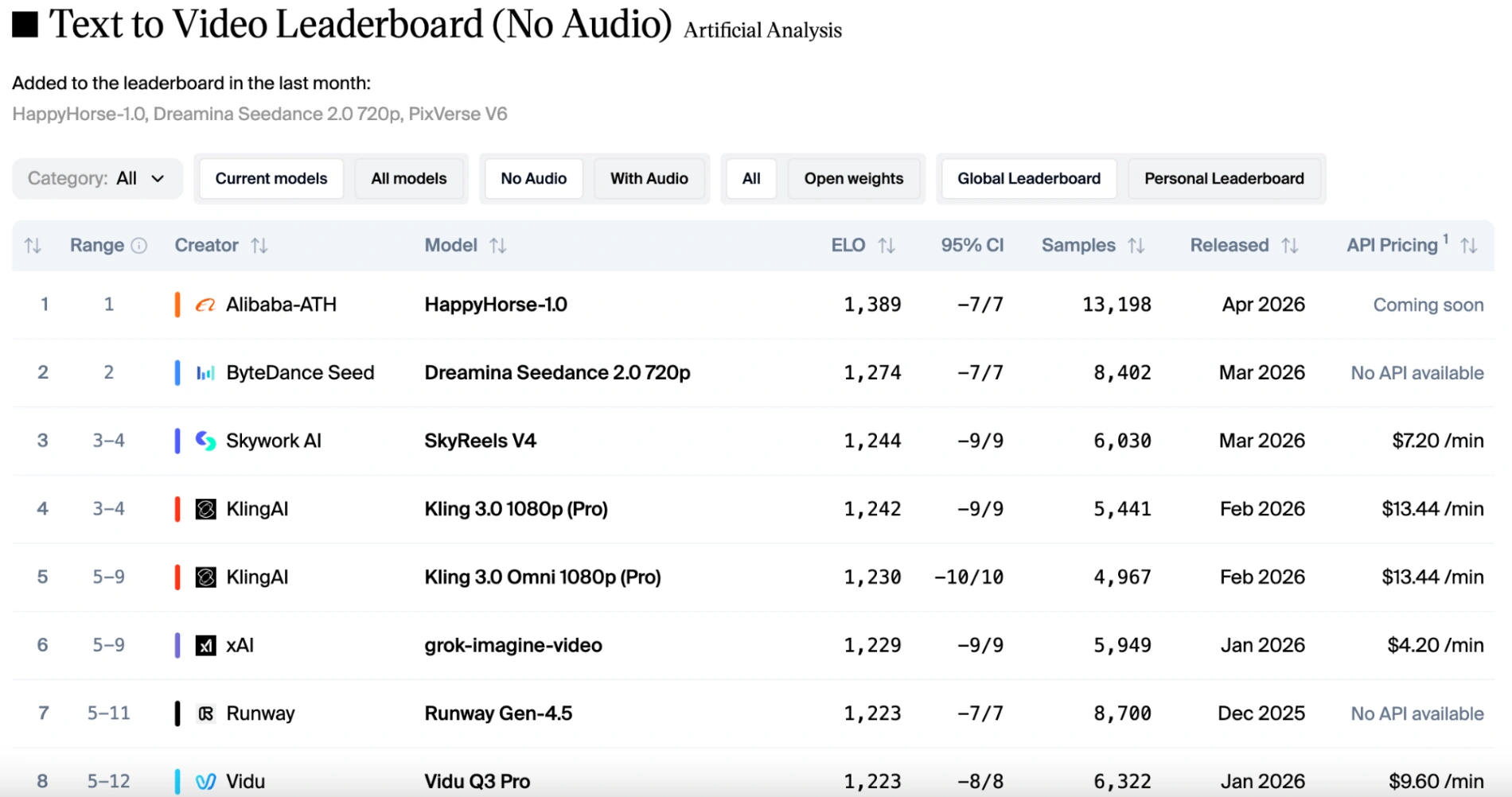

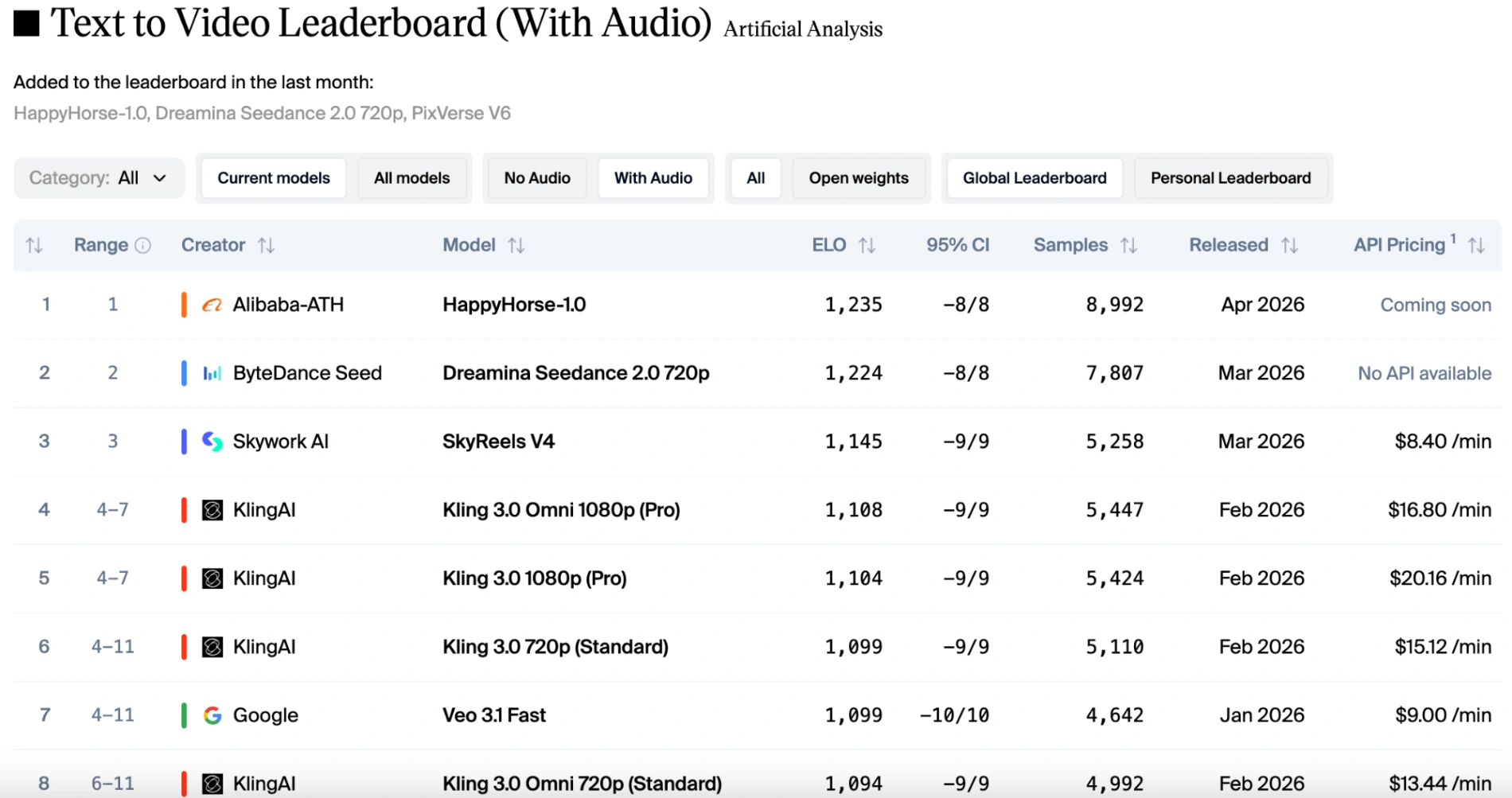

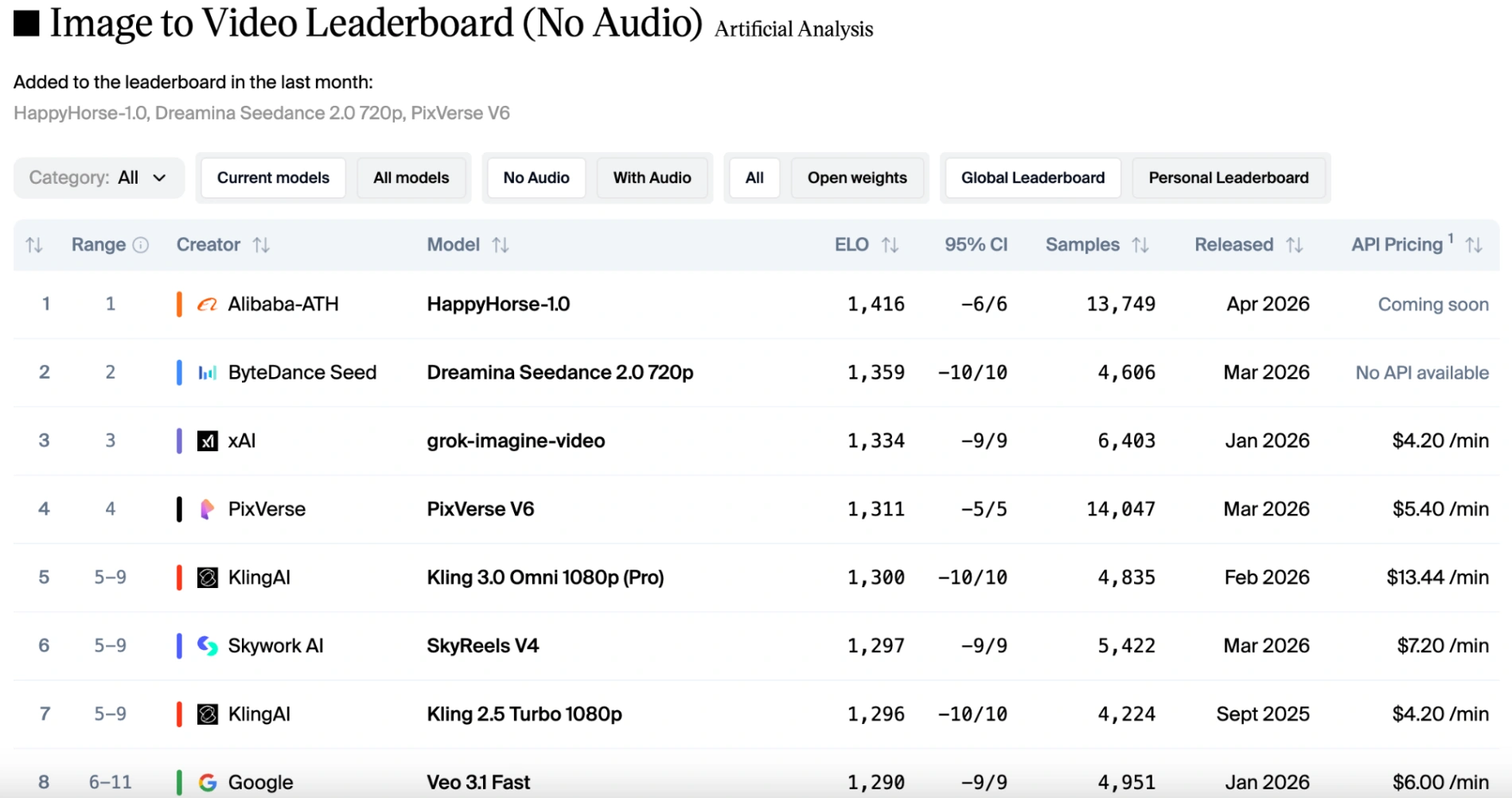

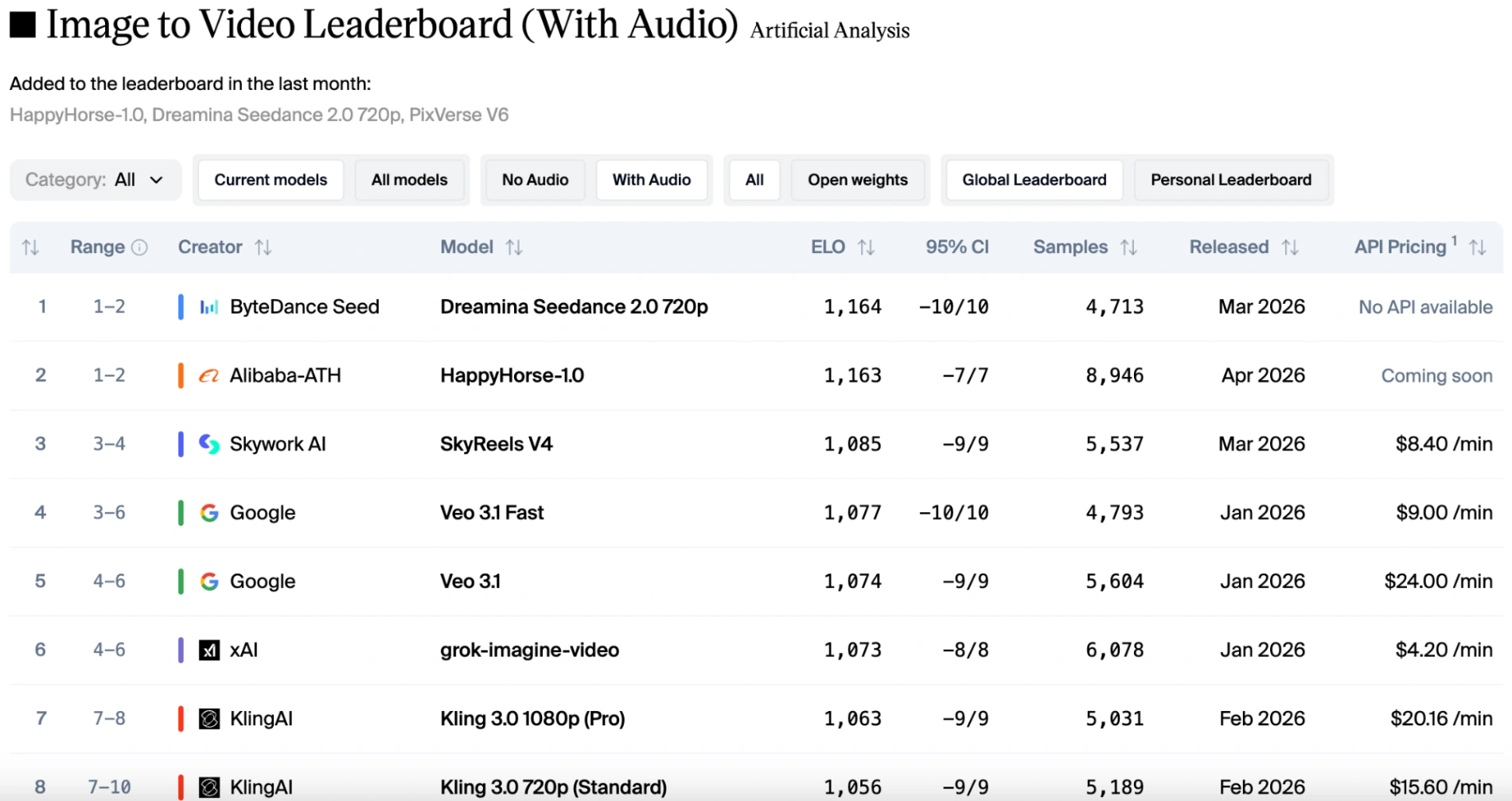

HappyHorse é o mais recente modelo de vídeo por IA da Unidade de Inovação em IA ATH da Alibaba. HappyHorse-1.0 ocupa o primeiro lugar no Artificial Analysis Video Arena. Ele suporta todas as quatro modalidades de geração de vídeo: Texto para Vídeo e Imagem para Vídeo, cada uma com e sem áudio nativo.

Síntese Unificada de Áudio e Vídeo

O HappyHorse 1.0 simplifica o processo criativo ao gerar vídeo de alta qualidade e efeitos sonoros sincronizados diretamente de um único prompt de texto. Ao processar tokens de vídeo e áudio dentro de uma sequência Transformer unificada, o modelo garante que os elementos auditivos se alinhem naturalmente com as ações na tela (como uma onda espirrando ou ruído de motor), o que ajuda a reduzir a necessidade de pós-produção de áudio adicional.

Animação Consistente de Imagem para Vídeo

Para dar vida a imagens estáticas, este modelo demonstra forte desempenho no Artificial Analysis Video Arena, incluindo uma pontuação Elo notável de 1416 na pista de imagem para vídeo (sem áudio). Ele se concentra em manter a consistência do personagem e preservar os detalhes ambientais, tornando-o uma opção prática para animar arte conceitual, retratos e fotos de produtos.

Modelagem de Movimento Consciente da Física

Para abordar problemas visuais comuns como movimentos "não naturais" e distorcidos em vídeo por IA, o HappyHorse utiliza um motor de movimento otimizado projetado para respeitar a física do mundo real. Isso ajuda a produzir passadas humanas fluidas, dinâmica de fluidos realista e panorâmicas de câmera estáveis. Ao entender as restrições físicas, o modelo reduz significativamente os artefatos de deformação frequentemente vistos em gerações anteriores de ferramentas de vídeo.

Compreensão Nativa de Prompt Multilíngue

Como um modelo multimodal nativo, o HappyHorse processa diretamente prompts em vários idiomas (incluindo inglês, chinês e japonês) sem depender de etapas de tradução intermediárias. Isso permite que os usuários insiram descrições culturalmente específicas em seu idioma nativo, ajudando a manter a precisão e as nuances visuais sutis do prompt de texto original.

Processo de Geração Eficiente de 8 Passos

A eficiência técnica é um foco-chave para o HappyHorse 1.0, que alcança saídas de vídeo claras em apenas 8 passos de remoção de ruído. Ao aproveitar uma arquitetura Transformer otimizada e técnicas de amostragem avançadas, o modelo fornece uma aceleração de ponta a ponta de 1,2x. Esse processo de geração mais rápido permite que os criadores testem ideias e iterem em seus projetos com mais conforto.

Sincronização Labial Precisa e Correspondência de Diálogo

O modelo integra capacidades dedicadas de sincronização labial projetadas para corresponder o diálogo falado com os movimentos da boca do personagem. Ao visar uma "WER ultrabaixa" (Taxa de Erro de Palavras), o HappyHorse garante que a fala gerada se alinhe naturalmente com os elementos visuais. Esse recurso simplifica o fluxo de trabalho de animação, minimizando a necessidade de ajustes manuais de tempo em software externo.

Criação de Conteúdo para Mídias Sociais

Os criadores podem produzir vídeos curtos envolventes para plataformas como TikTok ou YouTube Shorts de forma eficiente. Ao utilizar o processo de geração rápida e os recursos de áudio nativo, os influenciadores podem manter altas frequências de postagem enquanto reduzem significativamente o tempo de edição de áudio manual.

Marketing e Comerciais de Marca

As equipes de publicidade podem criar comerciais de marca de alta qualidade a partir de simples descrições de texto ou fotos de produtos. O suporte nativo de prompt multilíngue permite marketing global sem interrupções, permitindo que as equipes gerem campanhas localizadas culturalmente relevantes com facilidade.

Prototipagem de Desenvolvimento de Jogos

Os desenvolvedores de jogos podem prototipar rapidamente cenas cinematográficas e animações ambientais. Com a síntese unificada de áudio e vídeo, os estúdios podem gerar áudio espacial sincronizado junto com os visuais, ajudando a visualizar a atmosfera final do jogo no início do ciclo de desenvolvimento.

Animação de Arte Digital

Artistas digitais podem transformar ilustrações estáticas ou arte conceitual em peças móveis imersivas. Aproveitando as fortes capacidades de imagem para vídeo do modelo, os criadores podem manter consistência rigorosa do personagem e ambiental sem perder o estilo artístico original.

Narrativa Cinematográfica

Cineastas independentes podem simplificar a pré-produção e visualização de curtas-metragens. O motor de movimento consciente da física e as capacidades precisas de sincronização labial permitem que os diretores criem sequências narrativas complexas com movimentos humanos realistas e diálogo sincronizado.

Visualização de Produtos para E-commerce

Os varejistas podem elevar suas vitrines online transformando fotos estáticas de produtos em vídeos de showcase dinâmicos. O modelo garante precisão física e adiciona efeitos sonoros perfeitamente combinados (como o farfalhar de tecido ou cliques mecânicos), proporcionando uma experiência virtual envolvente para os compradores online.