HappyHorse - Le dernier modèle de vidéo IA d'Alibaba

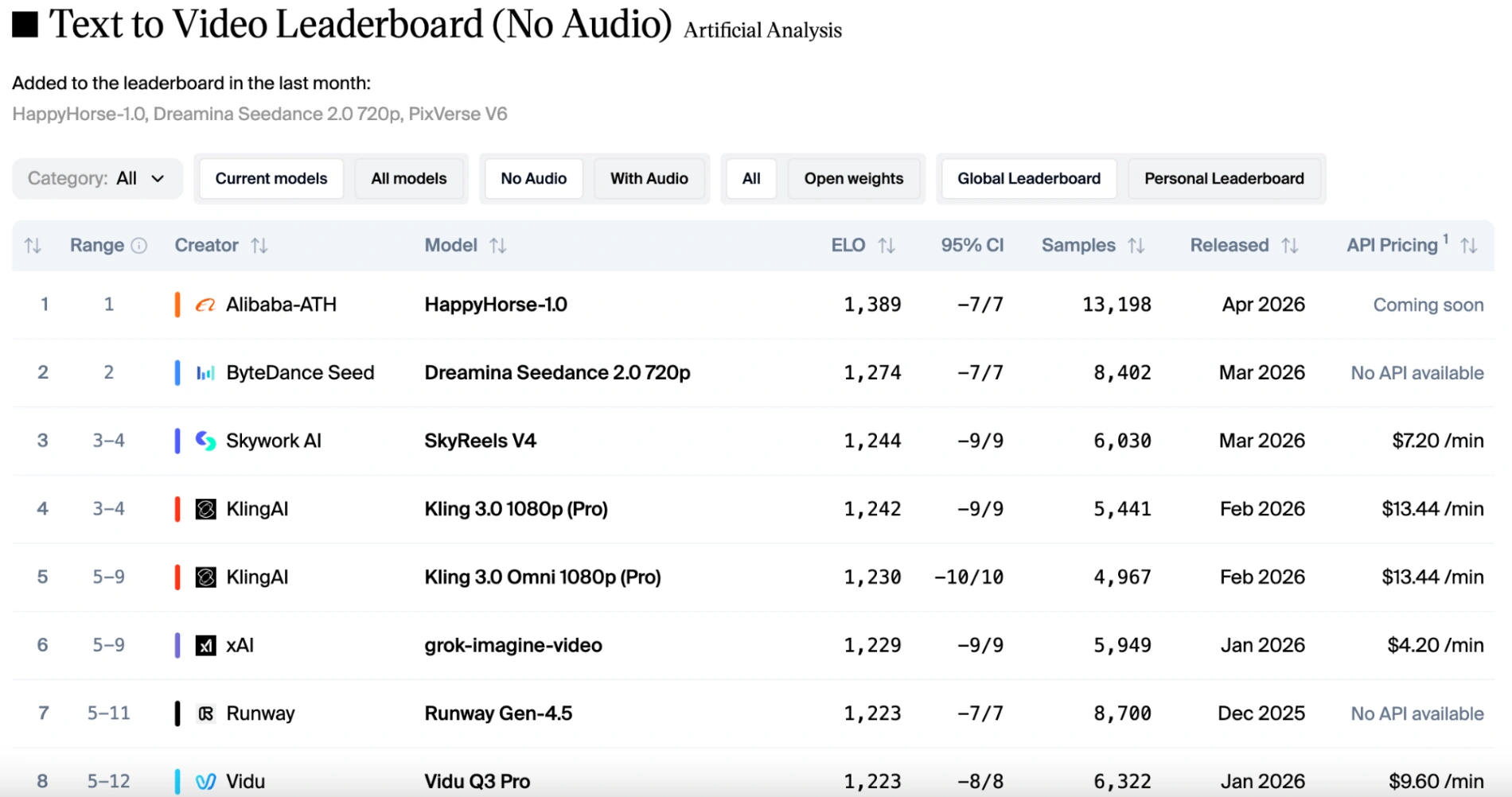

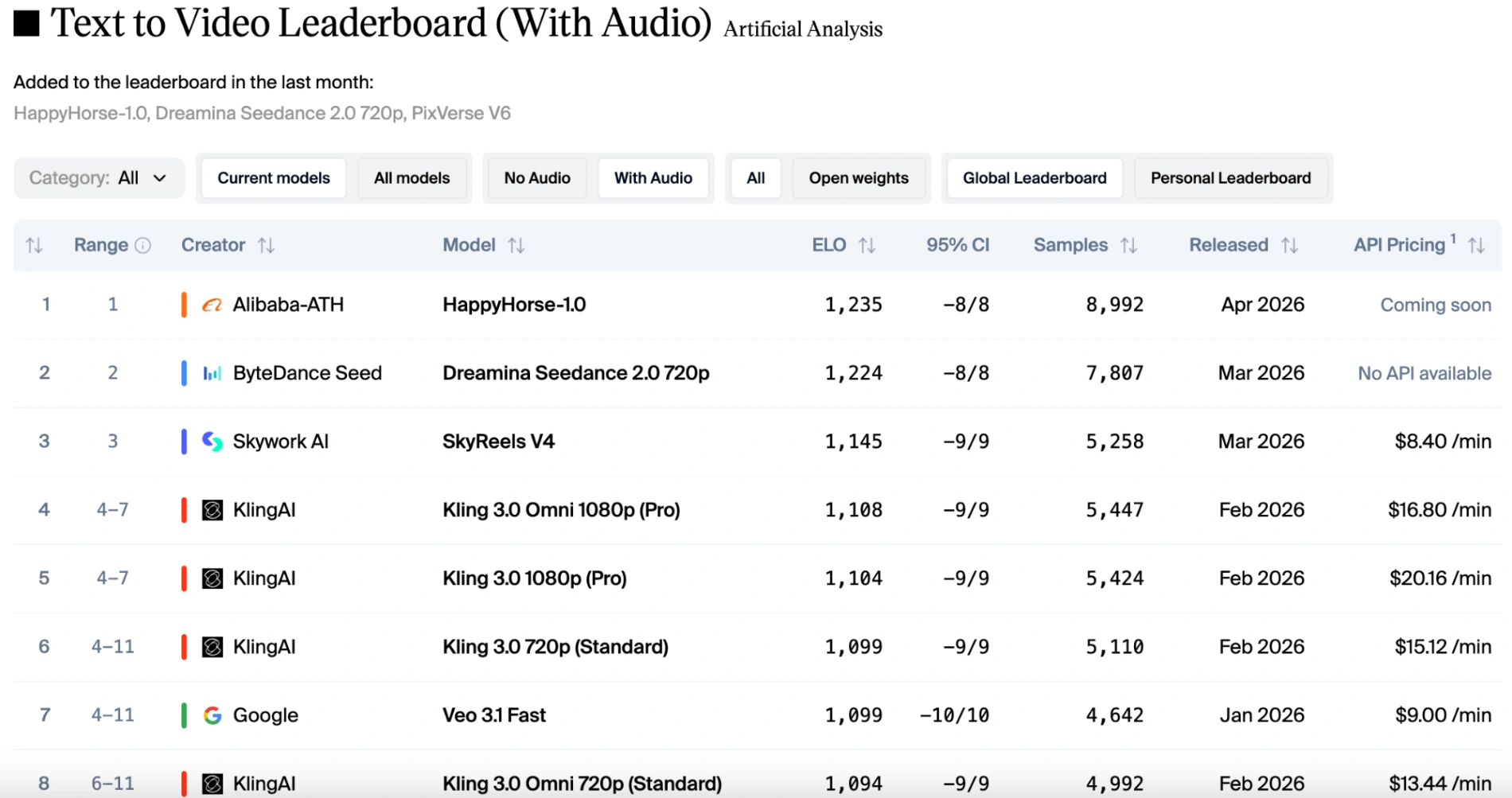

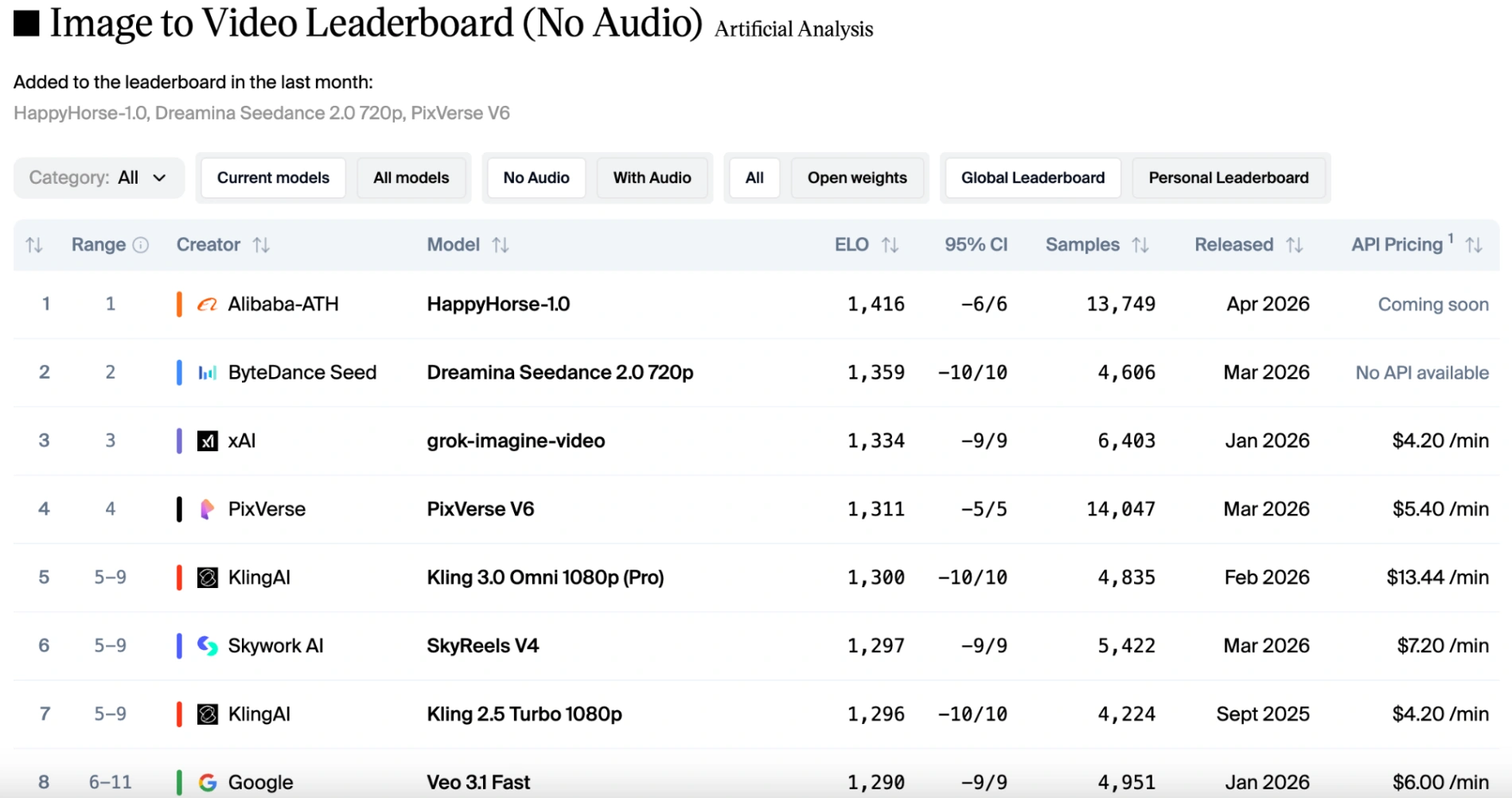

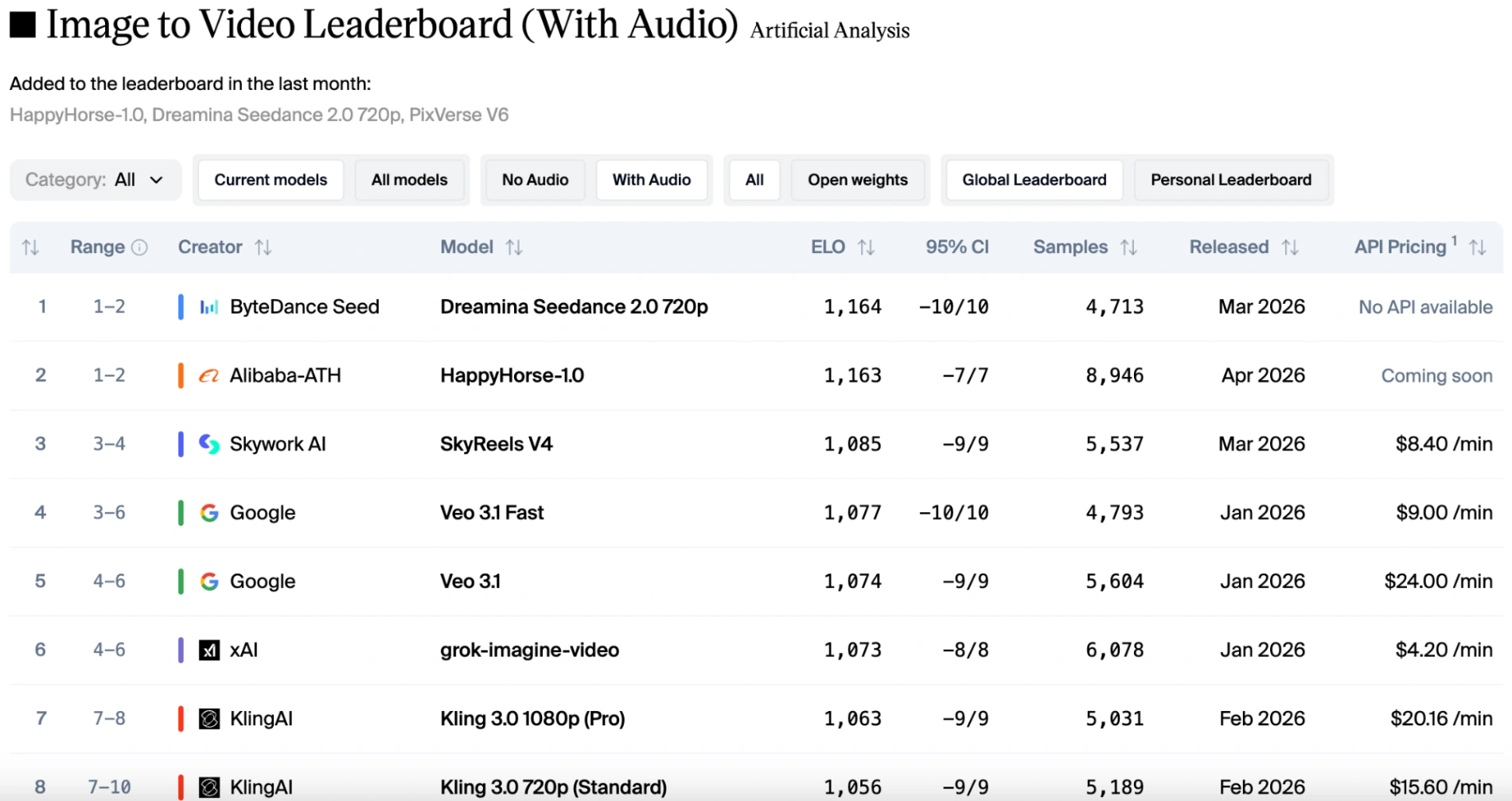

HappyHorse est le dernier modèle de vidéo IA de l'unité d'innovation IA ATH d'Alibaba. HappyHorse-1.0 se classe #1 sur l'Arène de Vidéo d'Analyse Artificielle. Il prend en charge les quatre modalités de génération vidéo : Texte vers vidéo et Image vers vidéo, chacun avec et sans audio natif.

Synthèse unifiée audio et vidéo

HappyHorse 1.0 simplifie le processus créatif en générant à la fois une vidéo de haute qualité et des effets sonores synchronisés directement à partir d'une seule invite texte. En traitant les jetons vidéo et audio dans une séquence Transformer unifiée, le modèle garantit que les éléments auditifs s'alignent naturellement avec les actions à l'écran (comme une vague éclaboussante ou un bruit de moteur), ce qui aide à réduire le besoin de post-production audio supplémentaire.

Animation cohérente d'image vers vidéo

Pour donner vie aux images statiques, ce modèle montre une performance forte sur l'Arène de Vidéo d'Analyse Artificielle, y compris un score Elo notable de 1416 dans la piste image vers vidéo (sans audio). Il se concentre sur le maintien de la cohérence des personnages et la préservation des détails environnementaux, ce qui en fait une option pratique pour animer des concept arts, des portraits et des photos de produits.

Modélisation de mouvement consciente de la physique

Pour résoudre les problèmes visuels courants comme les mouvements "non naturels" et déformés dans la vidéo IA, HappyHorse utilise un moteur de mouvement optimisé conçu pour respecter la physique du monde réel. Cela aide à produire des démarches humaines fluides, une dynamique des fluides réaliste et des panoramiques de caméra stables. En comprenant les contraintes physiques, le modèle réduit significativement les artefacts de déformation souvent observés dans les générations précédentes d'outils vidéo.

Compréhension native des invites multilingues

En tant que modèle multimodal natif, HappyHorse traite directement les invites en plusieurs langues (y compris l'anglais, le chinois et le japonais) sans dépendre d'étapes de traduction intermédiaires. Cela permet aux utilisateurs de saisir des descriptions culturellement spécifiques dans leur langue maternelle, aidant à maintenir la précision et les nuances visuelles subtiles de l'invite texte originale.

Processus de génération efficace en 8 étapes

L'efficacité technique est un objectif clé pour HappyHorse 1.0, qui atteint des sorties vidéo claires en seulement 8 étapes de débruiteur. En tirant parti d'une architecture Transformer optimisée et de techniques d'échantillonnage avancées, le modèle offre une accélération de bout en bout de 1,2x. Ce processus de génération plus rapide permet aux créateurs de tester des idées et d'itérer sur leurs projets plus confortablement.

Synchronisation labiale précise et correspondance des dialogues

Le modèle intègre des capacités de synchronisation labiale dédiées conçues pour correspondre aux dialogues parlés avec les mouvements de la bouche des personnages. En ciblant un "taux d'erreur de mots ultra-bas" (WER), HappyHorse garantit que la parole générée s'aligne naturellement avec les éléments visuels. Cette fonctionnalité rationalise le flux de travail d'animation en minimisant le besoin d'ajustements manuels de timing dans des logiciels externes.

Création de contenu pour les réseaux sociaux

Les créateurs peuvent produire des vidéos courtes engageantes pour des plateformes comme TikTok ou YouTube Shorts efficacement. En utilisant le processus de génération rapide et les fonctionnalités d'audio natif, les influenceurs peuvent maintenir des fréquences de publication élevées tout en réduisant significativement le temps d'édition audio manuel.

Marketing et publicités de marque

Les équipes publicitaires peuvent créer des publicités de marque de haute qualité à partir de simples descriptions texte ou de photos de produits. Le support natif des invites multilingues permet un marketing global transparent, permettant aux équipes de générer facilement des campagnes localisées culturellement pertinentes.

Prototypage de développement de jeux

Les développeurs de jeux peuvent prototyper rapidement des cinématiques et des animations environnementales. Avec la synthèse unifiée audio et vidéo, les studios peuvent générer de l'audio spatial synchronisé avec les visuels, aidant à visualiser l'atmosphère finale du jeu tôt dans le cycle de développement.

Animation d'art numérique

Les artistes numériques peuvent transformer des illustrations statiques ou des concept arts en pièces animées immersives. En tirant parti des fortes capacités d'image vers vidéo du modèle, les créateurs peuvent maintenir une cohérence stricte des personnages et de l'environnement sans perdre le style artistique original.

Narration cinématographique

Les cinéastes indépendants peuvent rationaliser la préproduction et la visualisation de courts-métrages. Le moteur de mouvement conscient de la physique et les capacités de synchronisation labiale précise permettent aux réalisateurs de créer des séquences narratives complexes avec des mouvements humains réalistes et des dialogues synchronisés.

Visualisation de produits pour le commerce électronique

Les détaillants peuvent améliorer leurs vitrines en ligne en transformant des photos de produits statiques en vidéos de présentation dynamiques. Le modèle garantit la précision physique et ajoute des effets sonores parfaitement adaptés (comme le froissement du tissu ou les clics mécaniques), offrant une expérience virtuelle engageante pour les acheteurs en ligne.