HappyHorse - 来自阿里巴巴的最新AI视频模型

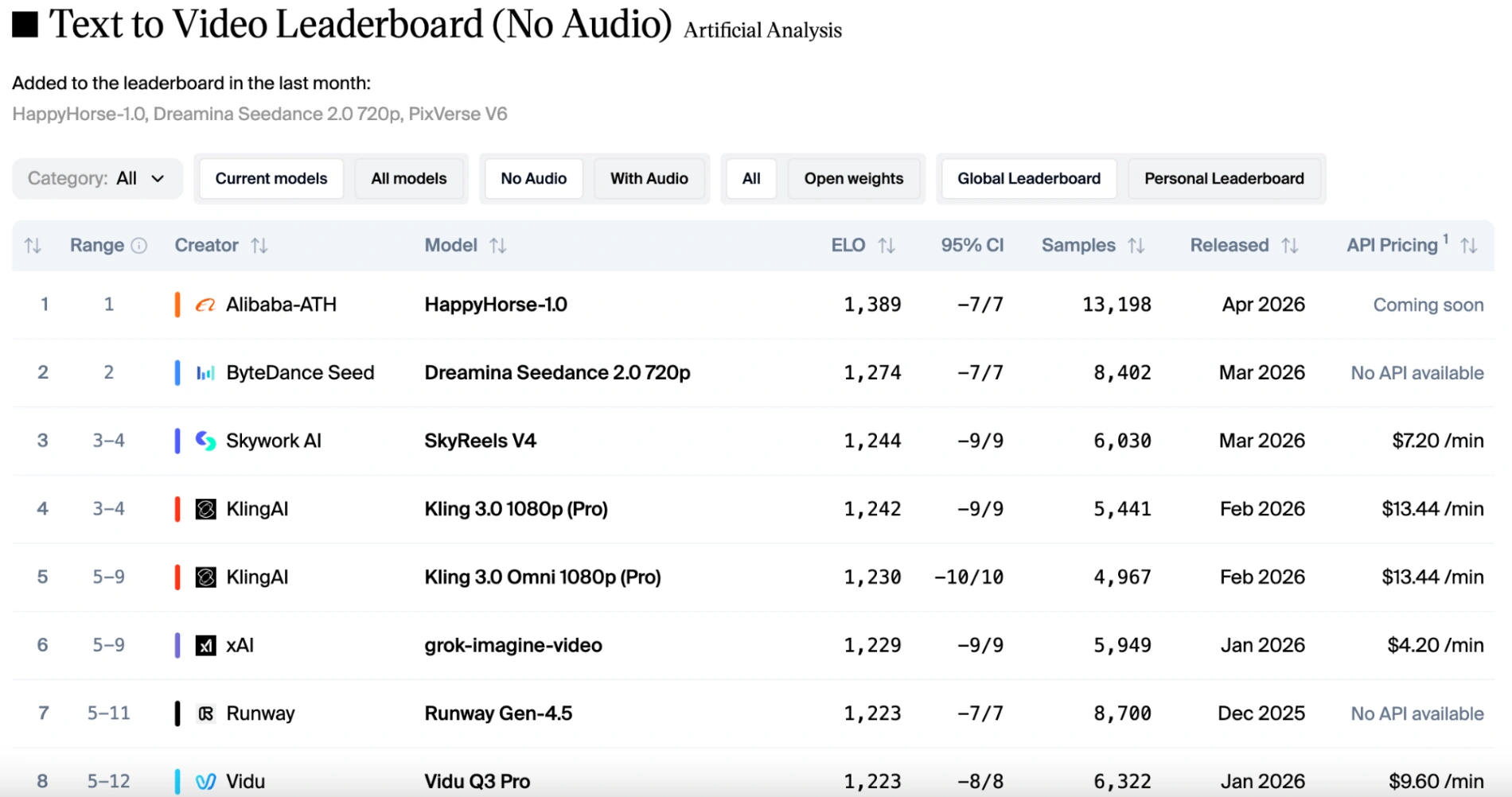

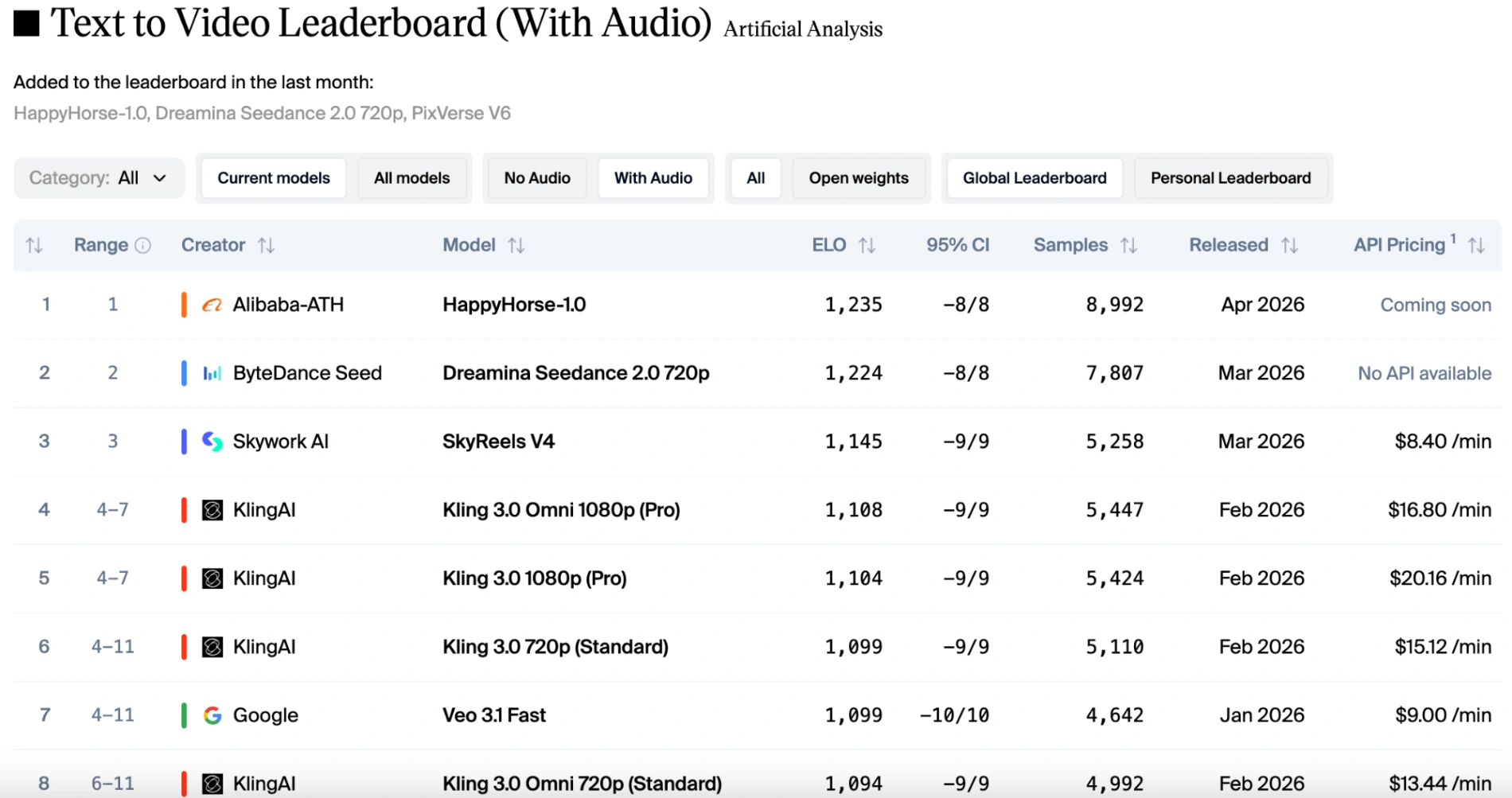

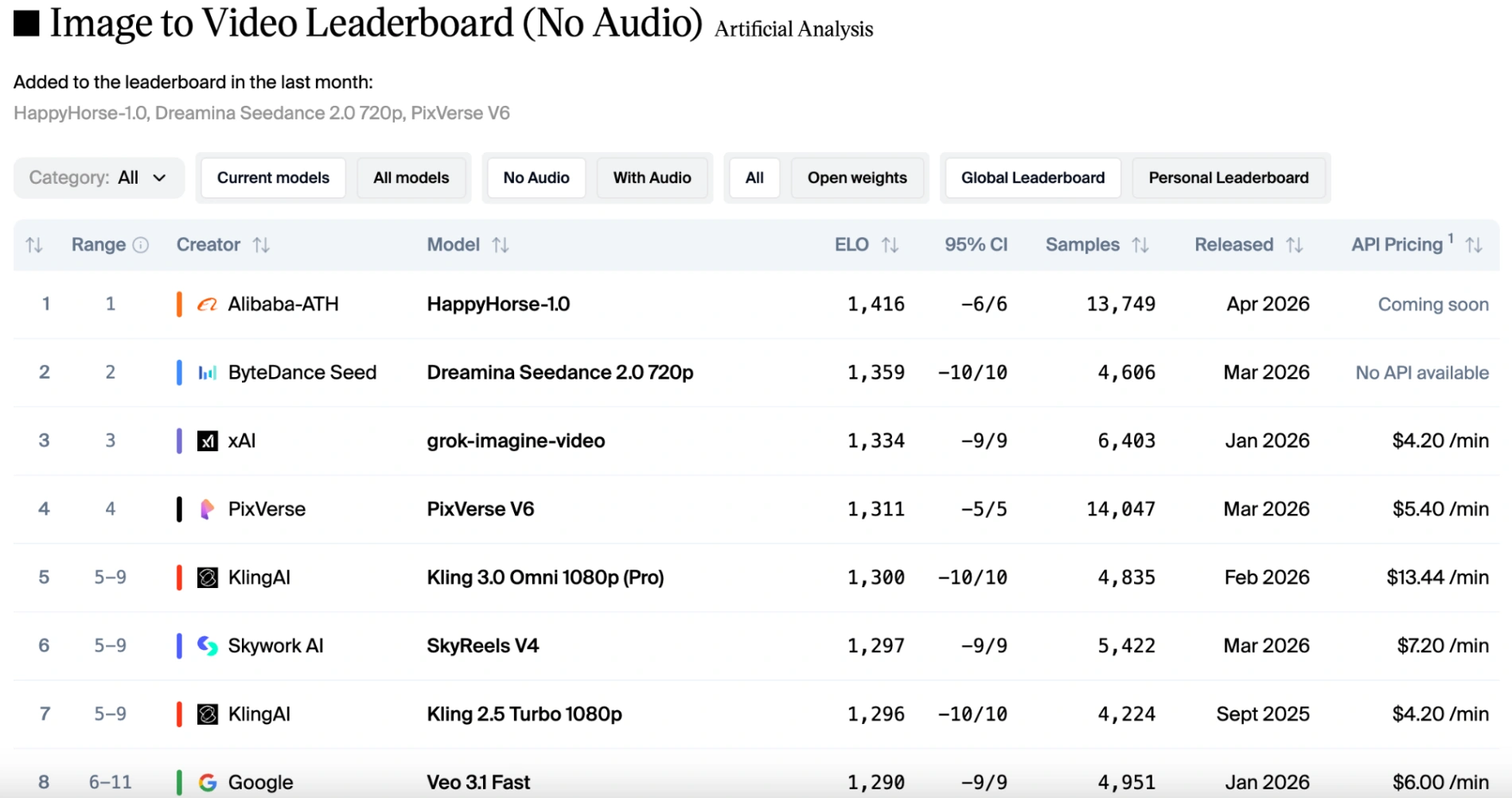

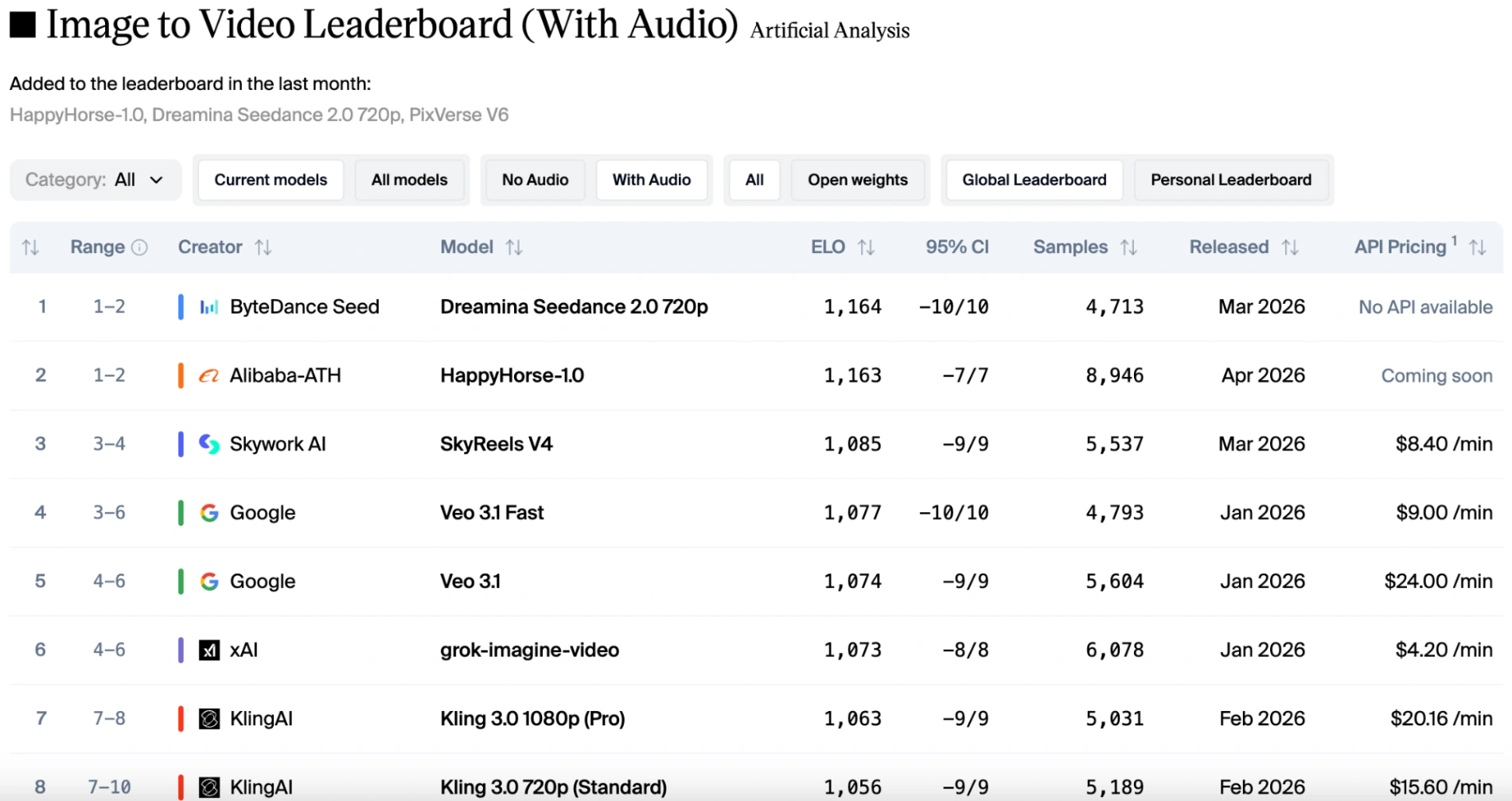

HappyHorse 是来自阿里巴巴ATH AI创新部门的最新AI视频模型。HappyHorse-1.0 在 Artificial Analysis Video Arena 中排名第一。它支持所有四种视频生成模式:文本转视频和图像转视频,每种都支持有原生音频和没有原生音频。

统一音频和视频合成

HappyHorse 1.0 通过从单个文本提示直接生成高质量视频和同步音效来简化创作过程。通过在统一Transformer序列中处理视频和音频令牌,该模型确保听觉元素与屏幕上的动作自然对齐(例如溅起的波浪或引擎噪音),这有助于减少额外的音频后期制作需求。

一致的图像转视频动画

为了将静态图像生动化,该模型在Artificial Analysis Video Arena上表现强劲,包括在图像转视频(无音频)轨道中取得1416的显著Elo分数。它专注于保持角色一致性和环境细节,使其成为动画概念艺术、肖像和产品照片的实用选择。

物理感知运动建模

为了解决AI视频中常见的视觉问题,如“不自然”、扭曲的运动,HappyHorse利用优化的运动引擎,设计以尊重真实世界物理。这有助于产生流畅的人体步态、真实的流体动力学和稳定的相机平移。通过理解物理约束,该模型显著减少了早期视频工具中常见的变形伪影。

原生多语言提示理解

作为原生多模态模型,HappyHorse直接处理多种语言(包括英语、中文和日语)的提示,无需依赖中间翻译步骤。这使用户能够用母语输入文化特定的描述,有助于保持原始文本提示的准确性和细微视觉差异。

高效的8步生成过程

技术效率是HappyHorse 1.0的关键焦点,该模型仅通过8个去噪步骤就能实现清晰的视频输出。通过利用优化的Transformer架构和先进采样技术,该模型提供了1.2倍的端到端加速。这个更快的生成过程使创作者能够更舒适地测试想法和迭代项目。

准确的唇形同步和对话匹配

该模型集成了专用的唇形同步功能,旨在匹配口语对话与角色嘴部动作。通过针对“超低WER”(词错误率),HappyHorse确保生成的语音与视觉元素自然对齐。此功能通过最小化在外部软件中手动调整时间的需求,简化了动画工作流程。

社交媒体内容创作

创作者可以高效地为TikTok或YouTube Shorts等平台制作吸引人的短视频。通过利用快速生成过程和原生音频功能,影响者可以保持高发布频率,同时显著减少手动音频编辑时间。

营销和品牌广告

广告团队可以从简单的文本描述或产品照片创建高质量的品牌广告。原生多语言提示支持使全球营销无缝进行,使团队能够轻松生成文化相关的本地化活动。

游戏开发原型制作

游戏开发者可以快速原型化电影式过场动画和环境动画。通过统一的音频和视频合成,工作室可以生成与视觉同步的空间音频,帮助在开发周期早期可视化最终游戏氛围。

数字艺术动画

数字艺术家可以将静态插图或概念艺术转化为沉浸式动态作品。利用该模型强大的图像转视频能力,创作者可以保持严格的角色和环境一致性,而不丢失原始艺术风格。

电影叙事讲故事

独立电影制作人可以简化短片的预制作和可视化。物理感知运动引擎和精确的唇形同步功能使导演能够创建具有真实人体动作和同步对话的复杂叙事序列。

电商产品可视化

零售商可以通过将静态产品拍摄转化为动态展示视频来提升在线商店。该模型确保物理准确性,并添加完美匹配的音效(例如织物沙沙声或机械点击声),为在线购物者提供引人入胜的虚拟体验。