HappyHorse: El último modelo de video de IA de Alibaba

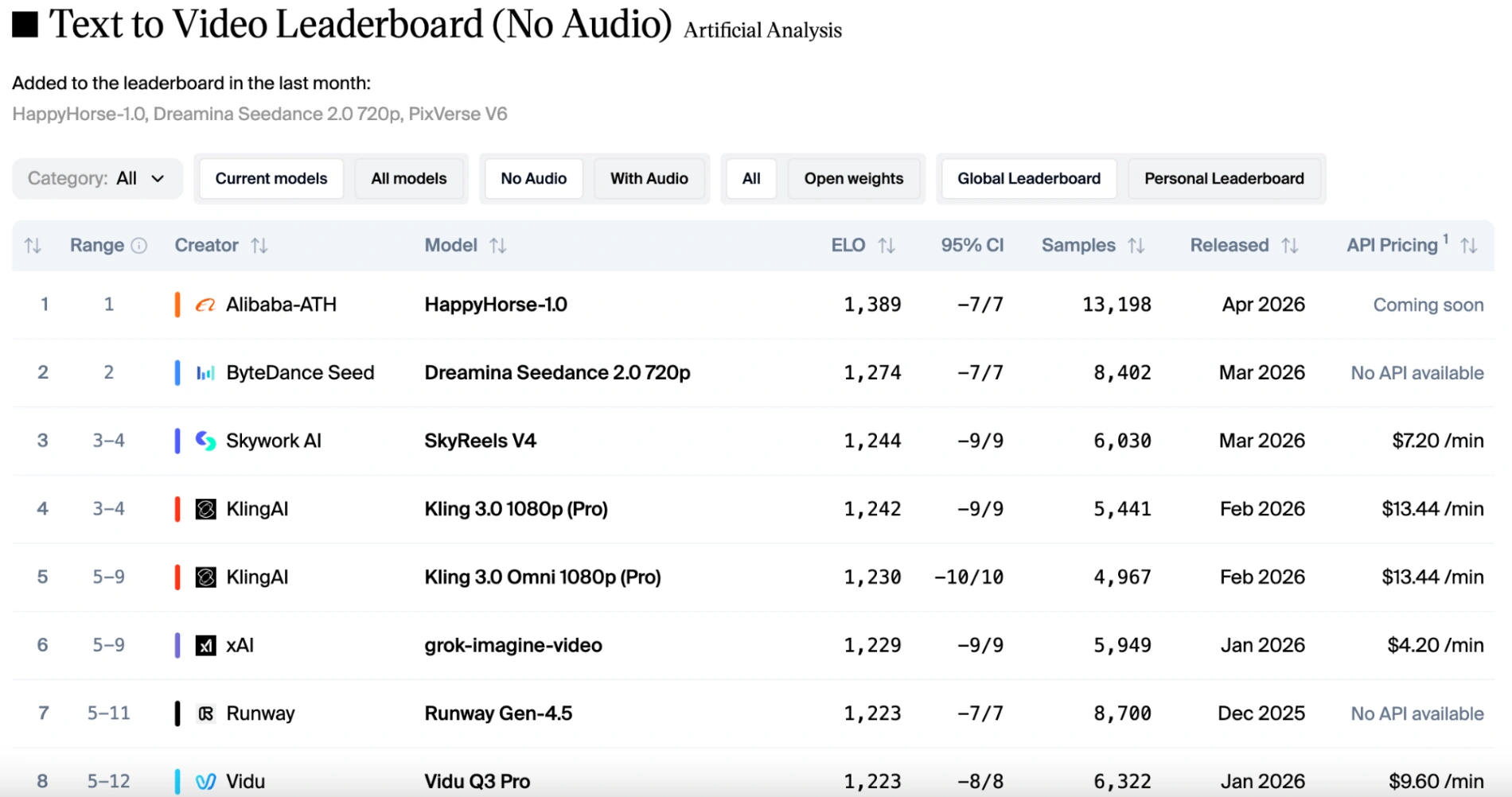

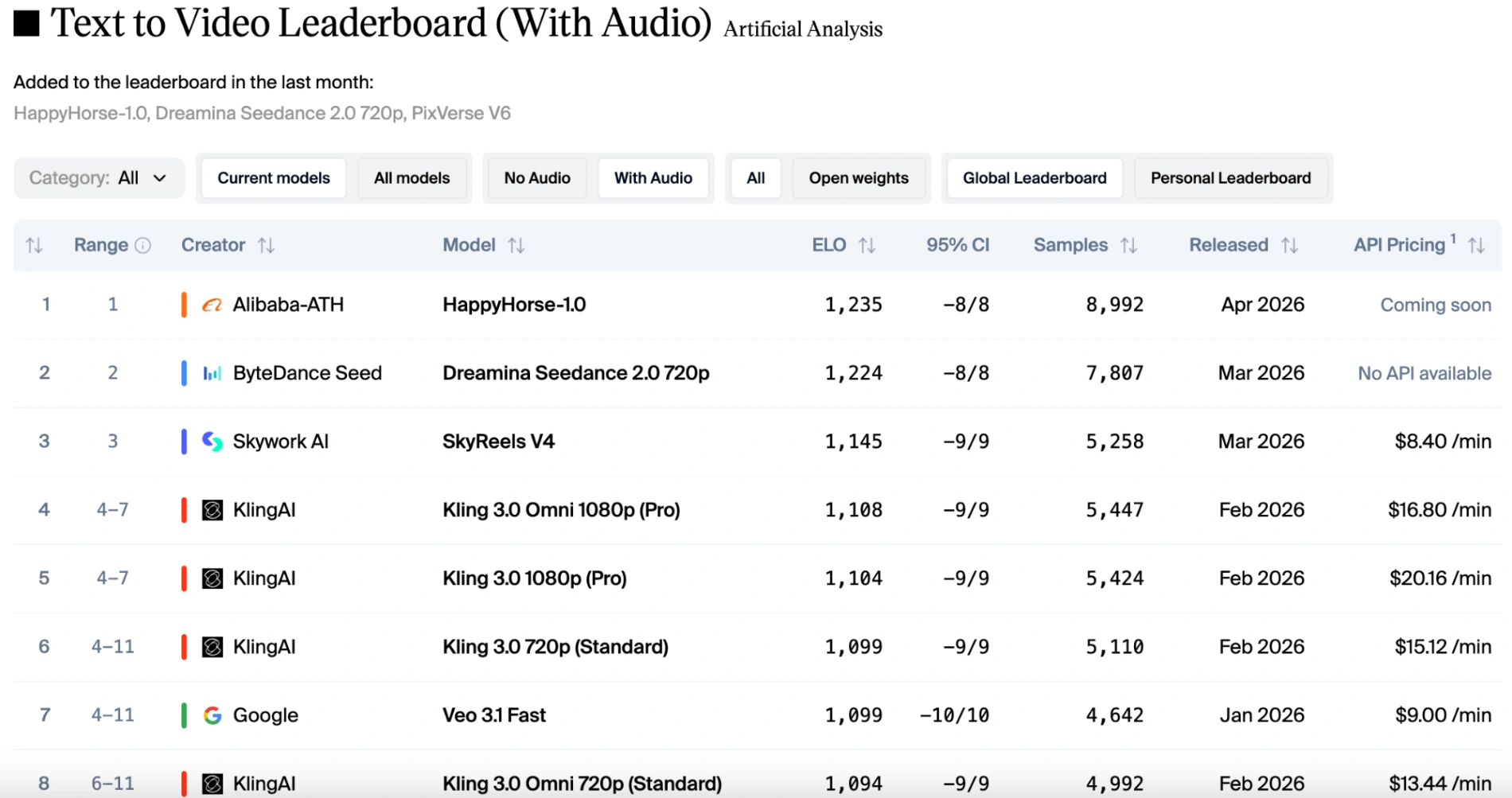

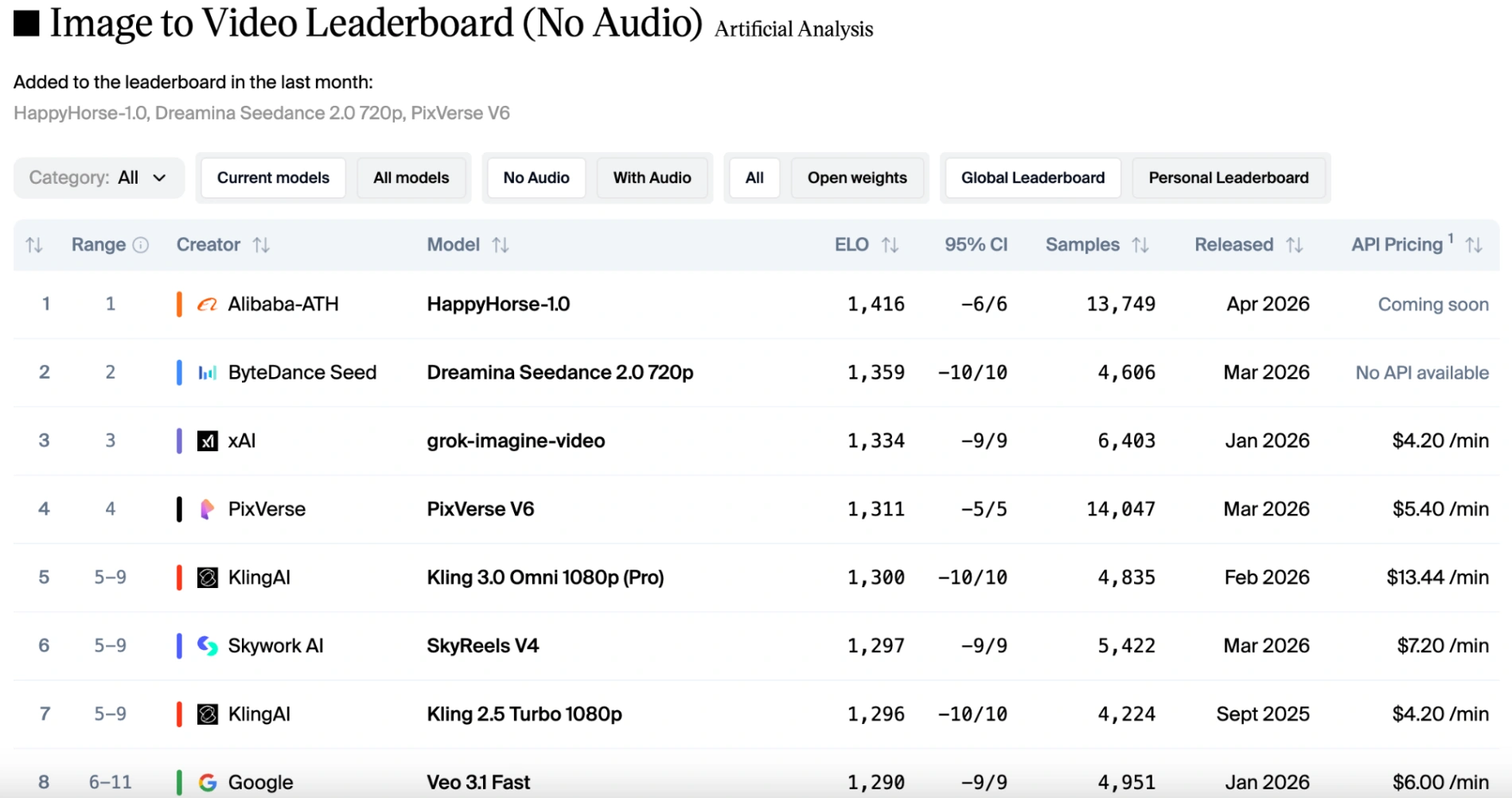

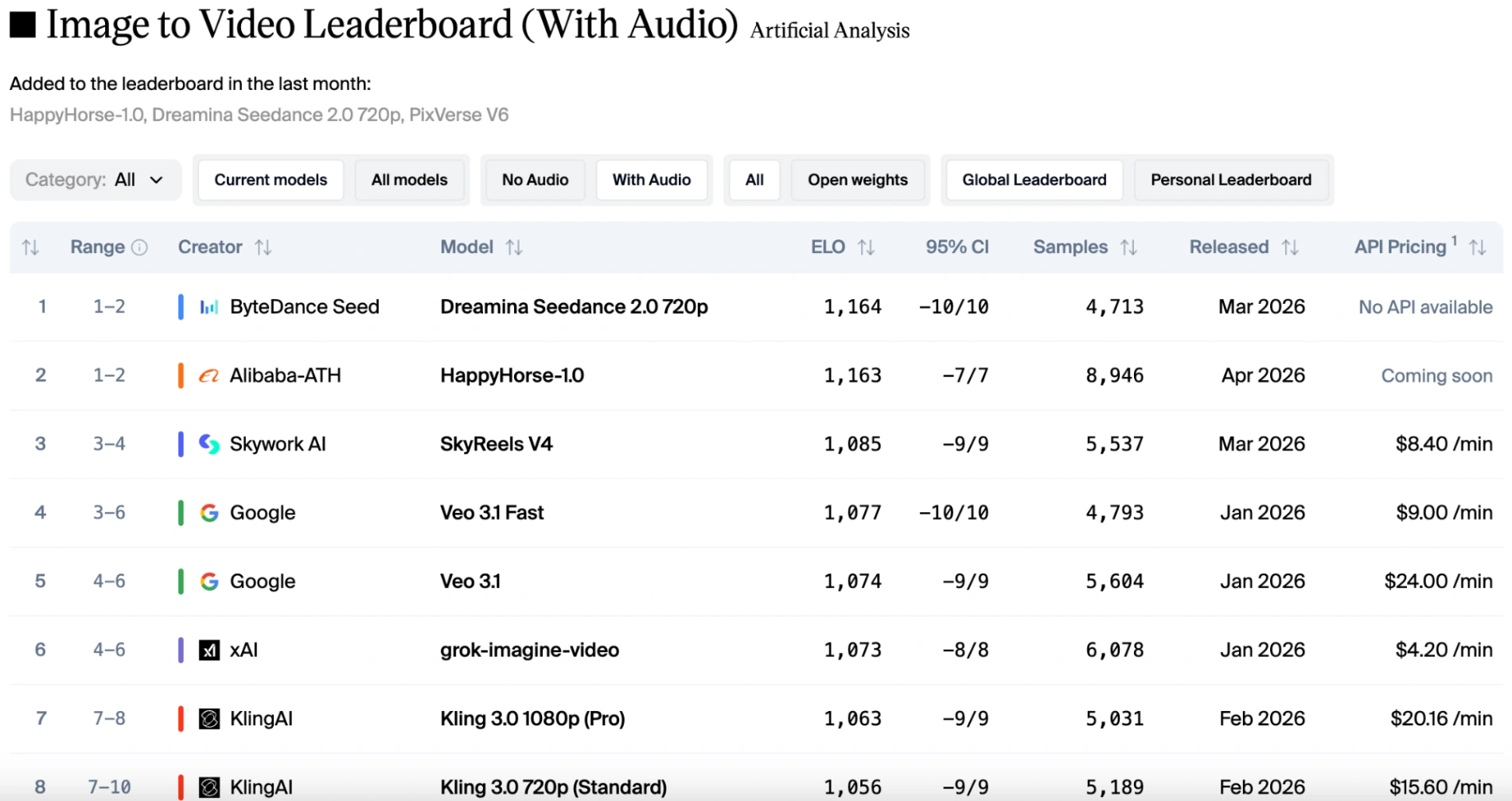

HappyHorse es el último modelo de video de IA de la Unidad de Innovación de IA ATH de Alibaba. HappyHorse-1.0 ocupa el puesto #1 en Artificial Analysis Video Arena. Soporta las cuatro modalidades de generación de video: Texto a Video e Imagen a Video, cada una con y sin audio nativo.

Síntesis unificada de audio y video

HappyHorse 1.0 simplifica el proceso creativo al generar tanto video de alta calidad como efectos de sonido sincronizados directamente desde un solo prompt de texto. Al procesar tokens de video y audio dentro de una secuencia Transformer unificada, el modelo garantiza que los elementos auditivos se alineen naturalmente con las acciones en pantalla (como una ola que salpica o ruido de motor), lo que ayuda a reducir la necesidad de postproducción de audio adicional.

Animación consistente de imagen a video

Para dar vida a imágenes estáticas, este modelo demuestra un fuerte rendimiento en Artificial Analysis Video Arena, incluyendo una puntuación Elo notable de 1416 en la pista de imagen a video (sin audio). Se centra en mantener la consistencia de los personajes y preservar los detalles ambientales, convirtiéndolo en una opción práctica para animar arte conceptual, retratos y fotos de productos.

Modelado de movimiento consciente de la física

Para abordar problemas visuales comunes como movimientos 'antinaturales' y distorsionados en video de IA, HappyHorse utiliza un motor de movimiento optimizado diseñado para respetar la física del mundo real. Esto ayuda a producir pasos humanos fluidos, dinámica de fluidos realista y paneos de cámara estables. Al comprender las restricciones físicas, el modelo reduce significativamente los artefactos de deformación a menudo vistos en generaciones anteriores de herramientas de video.

Comprensión nativa de prompts multilingües

Como modelo multimodal nativo, HappyHorse procesa directamente prompts en múltiples idiomas (incluyendo inglés, chino y japonés) sin depender de pasos de traducción intermedios. Esto permite a los usuarios ingresar descripciones culturalmente específicas en su idioma nativo, ayudando a mantener la precisión y los matices visuales sutiles del prompt de texto original.

Proceso eficiente de generación en 8 pasos

La eficiencia técnica es un enfoque clave para HappyHorse 1.0, que logra salidas de video claras en solo 8 pasos de denoising. Al aprovechar una arquitectura Transformer optimizada y técnicas de muestreo avanzadas, el modelo ofrece una aceleración de extremo a extremo de 1.2x. Este proceso de generación más rápido permite a los creadores probar ideas e iterar en sus proyectos de manera más cómoda.

Sincronización precisa de labios y coincidencia de diálogo

El modelo integra capacidades dedicadas de sincronización de labios diseñadas para igualar el diálogo hablado con los movimientos de la boca del personaje. Al apuntar a un 'WER ultra bajo' (Tasa de Error de Palabras), HappyHorse garantiza que el habla generada se alinee naturalmente con los elementos visuales. Esta característica agiliza el flujo de trabajo de animación al minimizar la necesidad de ajustes manuales de tiempo en software externo.

Creación de contenido para redes sociales

Los creadores pueden producir videos cortos atractivos para plataformas como TikTok o YouTube Shorts de manera eficiente. Al utilizar el proceso de generación rápida y las funciones de audio nativo, los influencers pueden mantener altas frecuencias de publicación mientras reducen significativamente el tiempo de edición de audio manual.

Marketing y comerciales de marca

Los equipos de publicidad pueden crear comerciales de marca de alta calidad a partir de simples descripciones de texto o fotos de productos. El soporte nativo de prompts multilingües permite un marketing global sin problemas, permitiendo a los equipos generar campañas localizadas culturalmente relevantes fácilmente.

Prototipado de desarrollo de juegos

Los desarrolladores de juegos pueden prototipar rápidamente escenas cinemáticas y animaciones ambientales. Con la síntesis unificada de audio y video, los estudios pueden generar audio espacial sincronizado junto con los elementos visuales, ayudando a visualizar la atmósfera final del juego temprano en el ciclo de desarrollo.

Animación de arte digital

Los artistas digitales pueden transformar ilustraciones estáticas o arte conceptual en piezas en movimiento inmersivas. Aprovechando las fuertes capacidades de imagen a video del modelo, los creadores pueden mantener una consistencia estricta de personajes y entorno sin perder el estilo artístico original.

Narrativa cinematográfica

Los cineastas independientes pueden agilizar la preproducción y visualización de cortometrajes. El motor de movimiento consciente de la física y las capacidades precisas de sincronización de labios permiten a los directores crear secuencias narrativas complejas con movimientos humanos realistas y diálogo sincronizado.

Visualización de productos de comercio electrónico

Los minoristas pueden elevar sus tiendas en línea convirtiendo fotos estáticas de productos en videos de exhibición dinámicos. El modelo garantiza precisión física y agrega efectos de sonido perfectamente igualados (como el crujido de tela o clics mecánicos), proporcionando una experiencia virtual atractiva para los compradores en línea.